نمودار نمودار در یادگیری عمیق

ترکیب نمودار در یادگیری عمیق به طور مستقیم با فرمول تجمعی نمودار که در بخش 6 به دست آمده بسیار متفاوت است ، اما هرگز تغییر نمی کند.(31)فرمول منبع مشتق است.

محتوای بخش 1 بسیار واضح توضیح داده شده است: ترکیب در یادگیری عمیق طراحی هسته با پارامترهای اشتراکی قابل آموزش است ، از(31)فرمول بسیار شهودی به نظر می رسد: پارامتر کانولوشن در کانولوشن نمودار است دمنآg(ساعت^(λمن)).

نسل اول GCN

در شبکه های طیفی و شبکه های متصل محلی در نمودارها ، به سادگی و تقریباًدمنآg(ساعت^(λمن))به هسته ای تبدیل می شوددمنآg(θمن)، کدام است:

(36)yایتوتیپتوتی=σ(توgθ(Λ)توتیایکس)

در میان آنها ،gθ(Λ)=(θ1⋱θn)

فرمول(36)این لایه در GCN نسل اول استاندارد است ، جایی کهσ(⋅)آیا تابع فعال سازی است ،Θ=(θ1،θ2،...،θn)دقیقاً مانند وزن در شبکه عصبی سه لایه ، یک پارامتر دلخواه است که با مقداردهی اولیه مقدار و سپس با استفاده از انتشار برگشت خطا تنظیم می شود.ایکساین بردار ویژگی مربوط به هر راس روی نمودار است (بردار متشکل از ویژگی های استخراج شده از یک مجموعه داده ویژه).

روش پارامتر نسل اول دارای اشکالاتی است: به طور عمده:

(1) هر تبلیغ رو به جلو باید محاسبه شود تو،دمنآg(θمن) وتوتیمحصول ماتریسی این سه ، به ویژه برای نمودارهای در مقیاس بزرگ ، هزینه محاسباتی بالاتری دارد که در مقاله استای(n2)پیچیدگی محاسباتی

(2) محلی سازی مکانی هسته کانولوشن خوب نیست (این بیشتر در بخش 9 توضیح داده شده است)

(3) هسته هسته همگراییnمولفه های

به دلیل نقایص فوق ، طراحی هسته کانولوشن نسل دوم به وجود آمد.

نسل دوم GCN

( شبکه های عصبی همگرایی در نمودارها با فیلتر طیفی سریع موضعی ) ، قرار دهیدساعت^(λمن)هوشمندانه طراحی شده است Σج=0کαجλمنج(تعریف اصلی این است:ساعت^(λمن)=Σمن=1نساعت(من)تومن*(من)) ، که:

(37)yایتوتیپتوتی=σ(توgθ(Λ)توتیایکس)

در میان آنها ،gθ(Λ)=(Σج=0کαجλ1ج⋱Σج=0کαجλnج)

به نظر می رسد فرمول فوق غیرقابل تشخیص است ، بنابراین با تبدیل آن با ضرب ماتریس نگاهی به آن می اندازیم.

(38)(Σج=0کαجλ1ج⋱Σج=0کαجλnج)=Σج=0کαجΛج

در میان آنها ،Λماتریس مورب است ، و عناصر مورب هستندλ1،λ2،...،λn، وΛجاین همچنین یک ماتریس مورب است و هر عنصر استλ1،λ2،...،λnازجقدرت. و جلوΣج=0کαجیک ثابت است ، نتیجه ضرب این دو ثابت ضرب شده در هر مقدار ماتریس است ، بنابراین برابر است با سمت چپ.

سپس می توانید صادرات انجام دهید:

(39)توΣج=0کαجΛجتوتی=Σج=0کαجتوΛجتوتی=Σج=0کαجلج

فرمول فوق به این دلیل ایجاد شده استل2=توΛتوتیتوΛتوتی=توΛ2توتی و توتیتو=E، که می تواند به گسترش یابدلجمورد.

تعریف هر نماد همان تعریف بخش 5 است.

فرمول(37)تبدیل می شود:

(40)yایتوتیپتوتی=σ(Σج=0کαجلجایکس)

در میان آنها(α1،α2،...،αک) این یک پارامتر دلخواه است که با انتساب اولیه و سپس با استفاده از انتشار خطا تنظیم می شود.لجماتریسلازجقدرت.

فرمول(40)مزایای هسته کانولوشن طراحی شده عبارتند از:

(1) هسته کانولوشن فقط داردکپارامترها ، به طور کلی کخیلی کوچکتر از n، پیچیدگی پارامترها بسیار کاهش می یابد.

(2) پس از تحول ماتریس ، به طرز جادویی مشخص شد که نیازی به تجزیه ویژه نیست و ماتریس لاپلاسی مستقیماً استفاده می شودلتحول ایجاد کنید. اما به دلیل محاسبهلج، پیچیدگی محاسباتی هنوز وجود داردای(n2)

(3) هسته کانولوشن محلی سازی فضایی خوبی دارد ، به ویژه ،کاین یک میدان پذیرای هسته کانولوشن است ، به این معنی که هر کانولوشن یک جمع وزنی از ویژگی های راس مرکزی همسایه K-hop را انجام می دهد و ضریب وزنαک

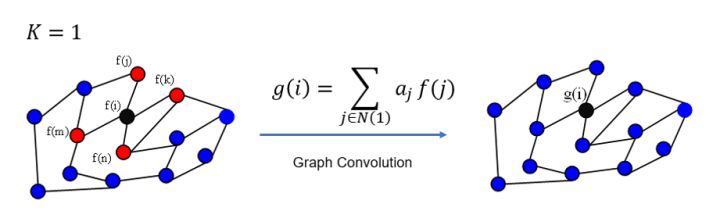

بصری تر ، _K_ = 1 به معنای انجام یک جمع وزنی از هر راس و ویژگی همسایه مرتبه اول آن است ، همانطور که در شکل زیر نشان داده شده است:

توضیح: چون کیک=1وقتی ، قسمت کانولوشن برابر است باαلایکس، و ازلبه شکل ماتریس ، مشاهده می شود که ماتریس لاپلاس فقط در استمرکزراس و راس مرتبه اول متصل (همسایه 1 هاپی) عناصر غیر صفر دارند و بقیه صفر هستند. بنابراین ، معادل انجام یک جمع وزنی از هر راس و ویژگی های همسایه مرتبه اول آن است و بنابراین توانایی درک محلی را دارد.علاوه بر این ، مجموع هر ردیف از ماتریس لاپلاس 0 است و عناصر مورب با مجموع عناصر باقیمانده در همان ردیف برابر است. این ماهیت جمع آوری را در نمودار نشان می دهد: یک راس انجام می شود در تمام گره های مجاور سود حاصل پس از یک تغییر کوچک.از آنجا که پارامترهایی در کانولوشن وجود داردαبنابراین می توان با تبلیغ عقب محاسبه کردلضریب در هیچ چیزی توضیح نمی دهد ، فقط مهم نیست که چه شکلی از ضرب وجود داردαموقعیت عنصر 0 همیشه عنصر 0 است.

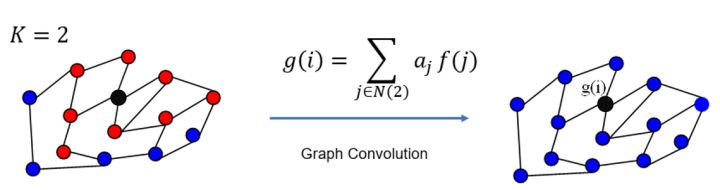

به طور مشابه ، وضعیت _K_ = 2 در شکل زیر نشان داده شده است:

شرح:

(41)ل+ل2=[8-511-50-515-62-601-68-62112-615-7-5-5-62-7151001-513]

بنابراین، هنگامی کهک=2وقتی ، قسمت کانولوشن برابر است با(Σج=02αجلجایکس)از بالال+ل2ملاحظه می شود که فقط رئوس آن و رئوس متصل مرتبه دوم (همسایه 2-هاپ) عناصر غیر صفر دارند و بقیه صفر هستند. بنابراین ، معادل انجام یک جمع وزنی از هر راس و ویژگی همسایه مرتبه دوم آن است و همچنین توانایی درک محلی را دارد. از آنجا که پارامترهایی در کانولوشن وجود داردαبنابراین می توان با تبلیغ عقب محاسبه کردل+ل2ضریب در هیچ چیزی توضیح نمی دهد ، فقط مهم نیست که چه شکلی از ضرب وجود داردαموقعیت عنصر 0 همیشه عنصر 0 است.

شکل بالا فقط یک راس را به عنوان مثال در نظر می گیرد.هر ترکیب GCN عملیاتی را که در شکل روی همه رئوس نشان داده شده است کامل می کند. تجمع فضایی به این معنی است که گره روی نمودار فقط با نقاط مجاور توزین می شود ، اما بحث اصلی در اینجا بحث پیچیدگی طیفی است ، که در فضای طیفی نمودار غیرمستقیم کانولوشن است. سیگنال بردار طول n است و فیلتر نیز بردار طول n است.

در این وبلاگ به ریاضیات و کاربردهای آن و تحقیقات در آنها پرداخته می شود. مطالب در این وبلاگ ترجمه سطحی و اولیه است و کامل نیست.در صورتی سوال یا نظری در زمینه ریاضیات دارید مطرح نمایید .در صورت امکان به آن می پردازم. من دوست دارم برای یافتن پاسخ به سوالات و حل پروژه های علمی با دیگران همکاری نمایم.در صورتی که شما هم بامن هم عقیده هستید با من تماس بگیرید.

در این وبلاگ به ریاضیات و کاربردهای آن و تحقیقات در آنها پرداخته می شود. مطالب در این وبلاگ ترجمه سطحی و اولیه است و کامل نیست.در صورتی سوال یا نظری در زمینه ریاضیات دارید مطرح نمایید .در صورت امکان به آن می پردازم. من دوست دارم برای یافتن پاسخ به سوالات و حل پروژه های علمی با دیگران همکاری نمایم.در صورتی که شما هم بامن هم عقیده هستید با من تماس بگیرید.