عامل بندی ماتریس غیر منفی [ ویرایش ]

واریانس باقیمانده کسری (FRV) توطئه برای PCA و NMF. [22] برای PCA ، مقادیر نظری سهم ویژه مقادیر ویژه باقی مانده است. در مقایسه ، منحنیهای FRV برای PCA به فلات مسطح می رسند که هیچ سیگنال به طور موقت ضبط نمی شود. در حالی که منحنی های NMF FRV به طور مداوم رو به کاهش هستند ، این نشانگر توانایی بهتر در گرفتن سیگنال است. منحنی های FRV برای NMF همچنین به سطوح بالاتر از PCA همگرا می شوند و این نشانگر خاصیت کمتری از NMF است.

فاکتورسازی ماتریس غیر منفی (NMF) روشی برای کاهش ابعاد است که در آن فقط از عناصر غیر منفی در ماتریس ها استفاده می شود ، بنابراین یک روش امیدوار کننده در نجوم است ، [20] [21] [22] به این معنا که سیگنال های اخترفیزیکی هستند. غیر منفی اجزای PCA از یکدیگر متعامد هستند ، در حالی که اجزای NMF همه غیر منفی هستند و بنابراین پایه ای غیر متعامد ایجاد می کنند.

در PCA ، سهم هر مؤلفه براساس بزرگی مقادیر ویژه مربوط به آن رتبه بندی می شود ، که معادل واریانس باقیمانده کسری (FRV) در تجزیه و تحلیل داده های تجربی است. [18] برای NMF ، اجزای آن فقط بر اساس منحنی های FRV تجربی رتبه بندی می شوند. [22] توطئه های ویژه ارزش ویژه کسری باقیمانده ، یعنی\ displaystyle 1- \ sum _ {i = 1} ^ {k} \ lambda _ {i} / \ sum _ {k = 1} ^ {n \ lambda _ {k}}

کلیات [ ویرایش ]

PCA پراکنده [ ویرایش ]

مقاله اصلی: PCA Sparse

یک نقطه ضعف خاص PCA این است که معمولاً اجزای اصلی ترکیبی خطی از کلیه متغیرهای ورودی هستند. PCA Sparse با یافتن ترکیبات خطی که شامل تنها چند متغیر ورودی است ، بر این نقطه ضعف غلبه می کند. این روش کلاسیک تجزیه و تحلیل مؤلفه اصلی (PCA) را برای کاهش ابعاد داده با افزودن محدودیت کمی در متغیرهای ورودی گسترش می دهد. چندین رویکرد ارائه شده است ، از جمله

- یک چارچوب رگرسیون ، [54]

- چارچوب برنامه نویسی آرامش / محور محور محور ، [55]

- چارچوب روش قدرت تعمیم یافته [56]

- یک چارچوب حداکثر به صورت متناوب [57]

- جستجوی حریص به جلو و عقب و روش های دقیق با استفاده از تکنیک های شاخه و محدود ، [58]

- چارچوب فرمول بندی بیزی. [59]

تحولات روش شناختی و نظری Sparse PCA و همچنین کاربردهای آن در مطالعات علمی اخیراً در مقاله پیمایشی بررسی شده است. [60]

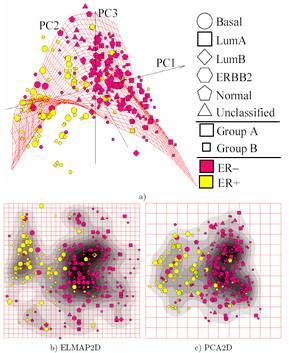

PCA غیرخطی [ ویرایش ]

PCA خطی در مقابل غیر خطی اصلی منیفولد [61] برای تجسم از سرطان پستان ریزآرایه داده: الف) پیکربندی گره ها و 2D سطح اصلی در 3D PCA خطی چند برابر. مجموعه داده خمیده است و نمی توان به صورت مناسب در یک صفحه اصلی 2D نقشه برداری کرد. ب) توزیع در مختصات سطح اصلی غیر خطی 2D داخلی (ELMap2D) همراه با تخمین چگالی نقاط. c) همان b) اما برای منیفولد 2 خطی PCA خطی (PCA2D). زیر گروه سرطان پستان "پایه" با ELMap2D به طور مناسب تر مشاهده می شود و برخی از ویژگی های توزیع در مقایسه با PCA2D بهتر حل می شوند. منیفولد های اصلی توسط نقشه های الاستیک تولید می شوندالگوریتم داده ها برای رقابت عمومی در دسترس است. [62] نرم افزار برای استفاده غیر تجاری به صورت رایگان موجود است. [63]

بسیاری از روشهای نوین برای کاهش ابعاد غیرخطی ، ریشه های نظری و الگوریتمی خود را در PCA یا K-ნიშნავს می یابند. ایده اصلی پیرسون این بود که یک خط مستقیم (یا هواپیما) بکشید که به بهترین گزینه برای مجموعه ای از نقاط داده تبدیل شود. اصلی منحنی و منیفولدهای [64] را در چارچوب هندسی طبیعی برای تعمیم PCA و گسترش تفسیر هندسی PCA صریح ساخت چند برابر تعبیه شده برای داده های تقریبی و با کدگذاری با استفاده از هندسی استاندارد طرح را بر روی چند برابر، آن است که توسط شکل نشان داده شده. همچنین الگوریتم نقشه الاستیک و آنالیز ژئودزیکی اصلی را مشاهده کنید. عمومی سازی دیگر محبوبیت PCA هسته است ، که مربوط به PCA است که در یک فضای تولید مثل هسته هیلبرت انجام می شود و همراه با یک هسته قطعی مثبت است.

در یادگیری زیرسطحی چندخطی ، [65] PCA به PCA چندلایه (MPCA) تعمیم یافته است که ویژگی ها را مستقیماً از بازنمایی های تانسور استخراج می کند. MPCA با انجام PCA در هر حالت از تانسور تکراری حل می شود. MPCA برای تشخیص چهره ، به رسمیت شناختن راه رفتن ، و غیره کاربرد دارد. MPCA به MPCA نامربوط ، MPCA غیر منفی و MPCA قوی نیز گسترش می یابد.

تجزیه و تحلیل مؤلفه اصلی N -way ممکن است با مدل هایی مانند تجزیه Tucker ، PARAFAC ، تجزیه و تحلیل عاملی چندگانه ، آنالیز همزمان اینرسی ، STATIS و DISTATIS انجام شود.

PCA قوی [ ویرایش ]

در حالی که PCA می یابد روش ریاضی بهینه (به عنوان در به حداقل رساندن مربع خطا)، آن است که هنوز حساس به نقاط دورافتاده در داده هایی را که تولید اشتباهات بزرگ، چیزی است که تلاش می کند روش برای جلوگیری از در وهله اول. بنابراین معمول است که قبل از محاسبه PCA ، محیطهای دور را جدا کنید. با این حال ، در برخی زمینه ها ، شناسایی مسافت دور مشکل است. به عنوان مثال ، در الگوریتم های داده کاوی مانند خوشه بندی همبستگی ، از قبل واگذاری امتیاز به خوشه ها و محیط های بیرون مشخص نشده است. تعمیم اخیراً PCA [66] که مبتنی بر PCA وزنی شده است ، با اختصاص وزنهای مختلف به اشیاء داده ها بر اساس میزان تخمین زده شده ، استحکام را افزایش می دهد.

انواع مقاوم در برابر PCA نیز بر اساس فرمولاسیون L1-norm ( L1-PCA ) ارائه شده است. [5] [3]

تجزیه و تحلیل مؤلفه های اصلی قوی (RPCA) از طریق تجزیه در ماتریس های درجه پایین و پراکنده ، اصلاح PCA است که با توجه به مشاهدات فاسد خوب کار می کند. [67] [68] [69]

تکنیک های مشابه [ ویرایش ]

تجزیه و تحلیل مؤلفه مستقل [ ویرایش ]

تجزیه و تحلیل مؤلفه های مستقل (ICA) به عنوان تجزیه و تحلیل مؤلفه اصلی به مشکلات مشابه هدایت می شود ، اما اجزای جداکننده جدا را به جای تقریب های پی در پی می یابد.

تجزیه و تحلیل مؤلفه شبکه [ ویرایش ]

با توجه به یک ماتریس {\ displaystyle E

- {\ نمایشگر A

دارای رتبه ستون کامل

- هر ستون {\ نمایشگر A

حداقل باید داشته باشد display \ نمایشگر L-1

صفرها کجا {\ نمایشگر L}

تعداد ستون ها است {\ نمایشگر A

(یا متناوبا تعداد ردیف های {\ نمایشگر P}

) توجیه این معیار این است که اگر یک گره از لایه نظارتی به همراه تمام گره های خروجی متصل به آن خارج شود ، نتیجه باید همچنان با یک ماتریس اتصال با درجه ستون کامل مشخص شود.

- {\ نمایشگر P}

باید دارای ردیف کامل باشد

بنابراین تجزیه تا ضرب یک مقیاس منحصر به فرد است. [70]

نرم افزار / کد منبع [ ویرایش ]

- ALGLIB - کتابخانه C ++ و C # که PCA و PCA کوتاه را اجرا می کند

- Analytica - عملکرد داخلی EigenDecomp مؤلفه های اصلی را محاسبه می کند.

- ELKI - شامل PCA برای طرح ریزی ، از جمله انواع قوی PCA ، و همچنین الگوریتم های خوشه بندی مبتنی بر PCA است .

- گرل - آنالیز مؤلفه اصلی را می توان از طریق pcaدستور یا از طریق princomp()عملکرد انجام داد.

- جولیا - از pcaعملکرد PCA در عملکرد MultivariateStats پشتیبانی می کند

- KNIME - نرم افزاری گره ای مبتنی بر جاوا برای تجزیه و تحلیل ، در این گره ها به نام های PCA ، PCA compute ، PCA Apply ، PCA معکوس آن را به راحتی انجام می دهند.

- Mathematica - تجزیه و تحلیل مؤلفه های اصلی را با استفاده از روش همبستگی و همبستگی با دستور PrincipalComponent انجام می دهد.

- MathPHP - کتابخانه ریاضیات PHP با پشتیبانی از PCA.

- جعبه ابزار آمار MATLAB - توابع princompو pca(R2012b) به مؤلفه های اصلی می پردازند ، در حالی که این تابع pcaresبه باقی مانده ها و ماتریس بازسازی شده برای تقریب PCA با درجه پایین می دهد.

- Matplotlib - کتابخانه پایتون یک بسته PCA در ماژول .mlab دارد.

- mlpack - اجرای تجزیه و تحلیل مؤلفه های اصلی را در C ++ ارائه می دهد .

- NAG Library - تجزیه و تحلیل مؤلفه های اصلی از طریق g03aaروال انجام می شود (در نسخه های Fortran از کتابخانه موجود است).

- NMath - کتابخانه عددی اختصاصی حاوی PCA برای چارچوب .NET .

- GNU Octave - محیط محاسباتی نرم افزار رایگان که اکثراً با MATLAB سازگار است ، عملکرد princompبه مؤلفه اصلی می دهد.

- OpenCV

- Oracle Database 12c - از طریق DBMS_DATA_MINING.SVDS_SCORING_MODEتعیین مقدار تنظیم از طریق آن پیاده سازی می شودSVDS_SCORING_PCA

- نارنجی (نرم افزاری) - PCA را در محیط برنامه نویسی بصری خود ادغام می کند. PCA یک نقشه Scree (درجه واریانس توضیح داده شده) را نمایش می دهد که در آن کاربر می تواند تعاملی تعداد اجزای اصلی را انتخاب کند.

- Origin - شامل PCA در نسخه Pro خود است.

- Qlucore - نرم افزار تجاری برای تجزیه و تحلیل داده های چند متغیره با پاسخ فوری با استفاده از PCA.

- R - بسته آماری رایگان ، توابع princompو prcompقابل استفاده برای تجزیه و تحلیل مؤلفه های اصلی. prcompاز تجزیه مقدار مفرد استفاده می کند که به طور کلی دقت عددی بهتری می دهد. برخی از بسته های که پیاده سازی PCA در R، شامل، اما نه محدود به: ade4، vegan، ExPosition، dimRed، و FactoMineR.

- SAS - نرم افزار اختصاصی؛ به عنوان مثال ، نگاه کنید به [71]

- Scikit-Learn - کتابخانه پایتون برای یادگیری ماشینی که شامل PCA ، PCA احتمالی ، هسته PCA ، Sparse PCA و سایر تکنیک های موجود در ماژول تجزیه است.

- Weka - کتابخانه جاوا برای یادگیری ماشین که شامل ماژول هایی برای محاسبه مؤلفه های اصلی است.

همچنین مشاهده کنید [ ویرایش ]

- تجزیه و تحلیل مکاتبات (برای جداول احتمالی)

- تجزیه و تحلیل مکاتبات متعدد (برای متغیرهای کیفی)

- تجزیه و تحلیل عاملی داده های مختلط (برای متغیرهای کمی و کیفی)

- همبستگی کانونی

- تقریب ماتریس CUR (می تواند جایگزین تقریب SVD با درجه پایین باشد)

- تجزیه و تحلیل مکاتبات محروم

- تجزیه حالت پویا

- Eigenface

- تحلیل عاملی اکتشافی (Wikiversity)

- کد کارخانه

- تجزیه و تحلیل مؤلفه اصلی عملکردی

- تجزیه و تحلیل داده های هندسی

- تجزیه و تحلیل مؤلفه مستقل

- هسته PCA

- تجزیه و تحلیل مؤلفه اصلی هنجار L1

- تقریب درجه پایین

- تجزیه ماتریس

- عامل بندی ماتریس غیر منفی

- کاهش ابعاد غیرخطی

- قانون اوجا

- مدل توزیع نقطه (PCA اعمال شده بر مورفومتری و بینایی کامپیوتر)

- تجزیه و تحلیل مؤلفه اصلی (ویکی پدیا)

- رگرسیون مؤلفه اصلی

- تجزیه و تحلیل طیف تک

- تجزیه مقدار منفرد

- PCA پراکنده

- کدگذاری را تغییر دهید

- حداقل مربعات وزن داشت

منبع

https://en.wikipedia.org/wiki/Principal_component_analysis

در این وبلاگ به ریاضیات و کاربردهای آن و تحقیقات در آنها پرداخته می شود. مطالب در این وبلاگ ترجمه سطحی و اولیه است و کامل نیست.در صورتی سوال یا نظری در زمینه ریاضیات دارید مطرح نمایید .در صورت امکان به آن می پردازم. من دوست دارم برای یافتن پاسخ به سوالات و حل پروژه های علمی با دیگران همکاری نمایم.در صورتی که شما هم بامن هم عقیده هستید با من تماس بگیرید.

در این وبلاگ به ریاضیات و کاربردهای آن و تحقیقات در آنها پرداخته می شود. مطالب در این وبلاگ ترجمه سطحی و اولیه است و کامل نیست.در صورتی سوال یا نظری در زمینه ریاضیات دارید مطرح نمایید .در صورت امکان به آن می پردازم. من دوست دارم برای یافتن پاسخ به سوالات و حل پروژه های علمی با دیگران همکاری نمایم.در صورتی که شما هم بامن هم عقیده هستید با من تماس بگیرید.